Ci sono enormi novità nel panorama globale...

legato all'Intelligenza artificiale. Qui qualche informazione importante.

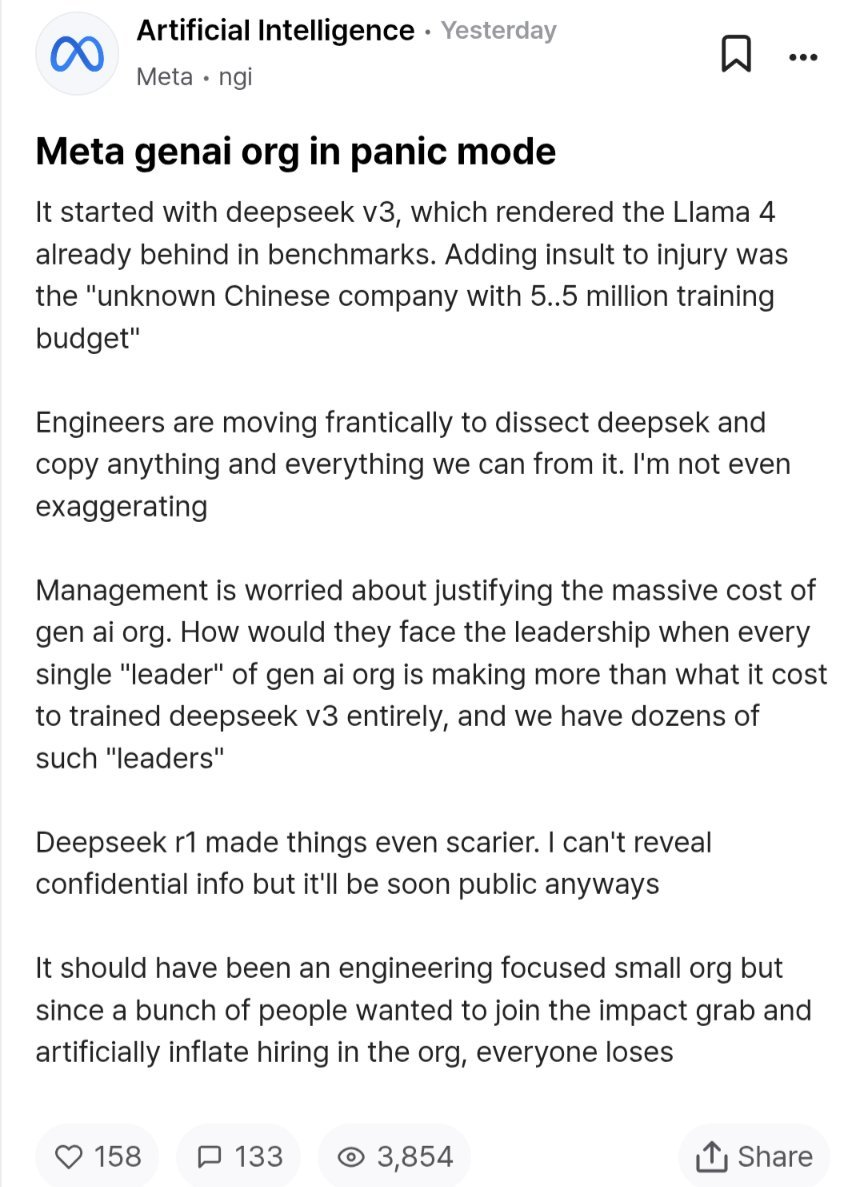

- Gli ingegneri dell'intelligenza artificiale di Meta sono in "modalità panico" e cercano di copiare le innovazioni di DeepSeek cinese (visto che è open source), mentre i truffatori di Google, Meta, Microsoft, Oracle, Nvidia... dell'infrastruttura dell'intelligenza artificiale CHE COSTA 1,000 O 2.000 MILIARDI !! non hanno aggiornato le proiezioni per il ritorno sull'investimento in data center, energia e calcolo. Da Trump ieri l'altro, Oracle e OpenAi più Softbank, (Masaoshi Son, che ha ARM) hanno dichiarato che metteranno 600 miliardi... Con Microsoft che oggi dice "ehi... noi 80 miliardi"

Sembra la truffa del secolo, perchè i cinesi stanno dimostrando questo mese che bastano milioni, no miliardi

Anche i giornalisti della CNBC stanno cogliendo la contraddizione interna: guarda il video qui sotto. PS ByteDance ha appena rilasciato anche un nuovo modello competitivo, Doubao-1.5 Pro, con costi di inferenza molto contenuti

CEO del settore tecnologico lanciano l'allarme sulle innovazioni di ByteDance e DeepSeek Americano: "I cinesi possono costruire questo con vecchi strumenti in una grotta!!! Perché non puoi farlo anche tu?!" American Tech: "Non sono cinese, signore"

🇺🇸🇨🇳 Tech CEOs sound alarm on ByteDance, DeepSeek breakthroughs

— 𝘊𝘰𝘳𝘳𝘪𝘯𝘦 (@OopsGuess) January 24, 2025

American: "The Chinese can build this with old hardware in a cave!!! why can't you do that?!"

American Tech: "Im not Chinese, sir" pic.twitter.com/afemMFuDxH

- Tutti parlano ora di questi cinesi, che hanno creato un modello valido quanto quello di OpenAI, Microsoft, Google e META (Facebook) spendendo quasi niente

e senza i top chips di Nvidia.

Ho discusso con Gemini 2.0 pro i costi stimati e per Chatgpt sono MILIARDI, per DeepSeek sono MILIONI.

Parliamo di differenza da 1000 a 1. Non 10 a 1, Ma 1,000 a 1

---

l costo totale cumulato e il costo annuale di ChatGPT per il 2025, poiché OpenAI non rilascia informazioni dettagliate sui suoi costi operativi. Tuttavia, possiamo fare alcune stime basate su informazioni pubbliche e analisi di esperti.

Costo totale cumulato:

Hardware: Si stima che OpenAI utilizzi decine di migliaia di GPU Nvidia A100 e H100 per addestrare e far funzionare ChatGPT. Considerando il costo di queste GPU (tra 30.000 e 40.000 dollari per H100), il costo dell'hardware potrebbe ammontare a centinaia di milioni o addirittura miliardi di dollari.

Elettricità: L'addestramento e l'esecuzione di modelli di intelligenza artificiale richiedono enormi quantità di energia. Si stima che il costo dell'elettricità per ChatGPT possa raggiungere decine di milioni di dollari all'anno.

Personale: OpenAI impiega centinaia di ricercatori, ingegneri e altri professionisti altamente qualificati. Il costo del personale potrebbe essere di centinaia di milioni di dollari all'anno.

Infrastruttura: OpenAI ha bisogno di data center e altre infrastrutture per ospitare e far funzionare i suoi modelli di IA. Il costo dell'infrastruttura potrebbe essere di decine di milioni di dollari all'anno.

Considerando tutti questi fattori, è plausibile che il costo totale cumulato di ChatGPT fino al 2025 sia di diversi miliardi di dollari.

---------------------

DeepSeek afferma di aver speso 6 milioni di dollari per addestrare il suo modello DeepSeek V3, e se il costo di ogni H800 fosse compreso tra 24.000 e 32.000 dollari, il numero di GPU utilizzate sarebbe effettivamente molto basso (tra 187 e 250).

Tuttavia, ci sono alcuni elementi da considerare che potrebbero spiegare questa discrepanza:

Costo totale di addestramento: I 6 milioni di dollari potrebbero riferirsi solo al costo delle GPU, escludendo altre spese come elettricità, manutenzione, infrastruttura, stipendi dei ricercatori, ecc. Il costo totale di addestramento di un modello di intelligenza artificiale può essere significativamente superiore al costo dell'hardware.

Acquisto in blocco e sconti: DeepSeek potrebbe aver ottenuto un prezzo più basso per le H800 grazie a sconti per acquisti in blocco o accordi speciali con Nvidia.

Utilizzo di altre risorse: È possibile che DeepSeek abbia utilizzato anche altre risorse di calcolo oltre alle H800, come ad esempio CPU o altre GPU meno potenti.

Ottimizzazione del processo di addestramento: DeepSeek potrebbe aver sviluppato tecniche di ottimizzazione per ridurre il tempo di addestramento e quindi il costo complessivo.

In realtà, DeepSeek ha utilizzato 2048 GPU Nvidia H800 per addestrare il suo modello V

************************************************************

Deepseek ha fondamentalmente infranto la narrazione del CAPEX dell'IA:

Presto i dirigenti delle aziende USA che puntano sull'intelligenza artificiale dovranno spiegare perché ci sono concorrenti cinesi che fanno le stesse cose a 1/10 del costo.

E perché abbiano speso miliardi in un asset in rapido deprezzamento che potrebbe non generare profitti immediati

STIAMO PER ASSISTERE ALL'IMPLOSIONE DELLA BOLLA DELL'"AI" U.S.A.?

LO VEDREMO PROSSIMAMENTE.......